Débloquer la Précision : Comment le Servo-Vidéo Basé sur les Vecteurs de Mouvement Transforme l’Assemblage Robotique. Découvrez le Prochain Saut en Efficacité et Précision de Fabrication Automatisée.

- Introduction au Servo-Vidéo Basé sur les Vecteurs de Mouvement

- Fondamentaux du Servo-Vidéo en Robotique

- Comment les Vecteurs de Mouvement Améliorent la Précision de l’Assemblage

- Architecture du Système et Composants Clés

- Approches Algorithmiques et Traitement en Temps Réel

- Intégration avec les Platesformes Robotique Industrielles

- Études de Cas : Applications dans les Lignes d’Assemblage

- Métriques de Performance et Analyse Comparative

- Défis et Limitations

- Tendances Futures et Directions de Recherche

- Conclusion et Impact sur l’Industrie

- Sources & Références

Introduction au Servo-Vidéo Basé sur les Vecteurs de Mouvement

Le servo-vidéo basé sur les vecteurs de mouvement est une stratégie de contrôle avancée en assemblage robotique qui exploite les informations dynamiques extraites des données visuelles pour guider les mouvements des robots avec une grande précision et adaptabilité. Contrairement aux approches basées sur la position ou l’image, qui s’appuient principalement sur des caractéristiques statiques ou des estimations de pose, les approches basées sur les vecteurs de mouvement utilisent le mouvement apparent des caractéristiques – connu sous le nom de flux optique – pour informer directement les actions de contrôle. Cette méthode est particulièrement avantageuse dans les tâches d’assemblage où les pièces peuvent être en mouvement, masquées ou sujettes à des perturbations imprévisibles, car elle permet une adaptation en temps réel aux changements de l’environnement.

Dans l’assemblage robotique, l’intégration du servo-vidéo basé sur les vecteurs de mouvement répond à plusieurs défis clés, tels que la nécessité d’un alignement à grande vitesse, la compensation des tolérances des pièces et la gestion robuste des ambiguïtés visuelles. En analysant continuellement les vecteurs de mouvement des caractéristiques ou des bords clés dans le champ de vision de la caméra, le robot peut ajuster dynamiquement sa trajectoire, garantissant un placement précis des pièces et réduisant le risque de collisions ou de désalignements. Cette approche facilite également l’automatisation de processus d’assemblage complexes nécessitant une manipulation fine et un retour d’information en temps réel, comme l’insertion de composants flexibles ou l’assemblage de pièces avec des tolérances serrées.

Les avancées récentes dans les algorithmes de vision par ordinateur et le matériel d’imagerie à grande vitesse ont encore amélioré la faisabilité et la performance du servo-vidéo basé sur les vecteurs de mouvement dans les environnements industriels. Les efforts de recherche et de développement d’organisations telles que l’Institut des Ingénieurs Électriciens et Électroniciens (IEEE) et la communauté du Robot Operating System (ROS) continuent de favoriser l’innovation dans ce domaine, en faisant une solution prometteuse pour les systèmes d’assemblage robotique de nouvelle génération.

Fondamentaux du Servo-Vidéo en Robotique

Le servo-vidéo est une technique de contrôle qui exploite l’information visuelle pour guider les manipulateurs robotiques, permettant une interaction précise et adaptative avec des environnements dynamiques. Dans le contexte de l’assemblage robotique, le servo-vidéo basé sur les vecteurs de mouvement représente une avancée significative en utilisant le mouvement apparent des caractéristiques – les vecteurs de mouvement – extraits de séquences d’images pour informer les décisions de contrôle en temps réel. Contrairement aux méthodes traditionnelles de servo-vidéo basées sur la position ou l’image, qui reposent sur la localisation explicite des caractéristiques ou l’estimation de pose, les approches basées sur les vecteurs de mouvement exploitent directement les changements temporels dans les données d’image, souvent dérivés des algorithmes de flux optique. Cela permet un suivi robuste du mouvement des objets et de l’alignement, même en présence d’occlusions partielles ou de conditions d’éclairage variables.

Le principe de base implique de mapper les vecteurs de mouvement observés dans le plan de l’image aux vitesses requises de l’outil effecteur dans l’espace de travail du robot. Ce mappage est généralement réalisé grâce à la matrice d’interaction (ou jacobien image), qui relie les changements dans les caractéristiques d’image au mouvement du robot. En mettant à jour continuellement les commandes de contrôle en fonction du flux d’information visuelle en temps réel, le système peut compenser dynamiquement les incertitudes et perturbations inhérentes aux tâches d’assemblage, telles que les désalignements de pièces ou les mouvements inattendus des objets. Des recherches récentes ont démontré que le servo-vidéo basé sur les vecteurs de mouvement peut considérablement améliorer la flexibilité et la fiabilité des lignes d’assemblage robotiques, en particulier dans des environnements non structurés ou semi-structurés où les méthodes traditionnelles peuvent rencontrer des difficultés IEEE. L’intégration de techniques avancées de vision par ordinateur et de traitement d’image à grande vitesse permet également à ces systèmes de fonctionner aux cycles rapides exigés par la fabrication moderne ABB.

Comment les Vecteurs de Mouvement Améliorent la Précision de l’Assemblage

Les vecteurs de mouvement jouent un rôle crucial dans l’amélioration de la précision des tâches d’assemblage robotique en fournissant des informations quantitatives en temps réel sur le mouvement d’objets et de caractéristiques dans le champ de vision du robot. Dans le servo-vidéo basé sur les vecteurs de mouvement, le système de contrôle du robot analyse en continu le déplacement des caractéristiques visuelles entre les images consécutives, permettant des ajustements dynamiques à la trajectoire et au positionnement de l’outil effecteur du robot. Cette approche permet au système de compenser les incertitudes telles que les désalignements de pièces, les tolérances mécaniques et les perturbations environnementales, qui sont courantes dans les environnements d’assemblage industriels.

En tirant parti des vecteurs de mouvement, les robots peuvent atteindre une précision sub-millimétrique dans des tâches telles que l’insertion de goupilles dans des trous, l’alignement de composants et le suivi de surfaces. La boucle de retour continue fournie par les vecteurs de mouvement permet des corrections douces et adaptatives, réduisant le risque de collisions et d’erreurs d’assemblage. De plus, cette méthode prend en charge des opérations à grande vitesse, car l’efficacité computationnelle de l’extraction des vecteurs de mouvement permet des temps de réponse rapides sans sacrifier la précision. Des études récentes ont démontré qu’intégrer l’analyse des vecteurs de mouvement avec des algorithmes de contrôle avancés améliore considérablement les taux de réussite de l’assemblage et réduit les temps de cycle dans des environnements complexes et non structurés (IEEE).

En outre, le servo-vidéo basé sur les vecteurs de mouvement facilite la manipulation de pièces déformables ou flexibles, où le contrôle basé sur la position peut échouer en raison de changements de forme imprévisibles. En se concentrant sur le mouvement relatif des caractéristiques, le système peut s’adapter aux variations de la géométrie des pièces et des conditions d’assemblage, améliorant ainsi la robustesse et la précision (Springer). Cette capacité est cruciale pour la fabrication moderne, où la flexibilité et l’adaptabilité sont de plus en plus exigées.

Architecture du Système et Composants Clés

L’architecture du système pour le servo-vidéo basé sur les vecteurs de mouvement dans l’assemblage robotique intègre généralement plusieurs composants clés pour permettre une manipulation précise et en temps réel des pièces. Au cœur de l’architecture, on trouve un capteur de vision (souvent une caméra haute vitesse ou un système de vision stéréo) monté pour observer l’espace de travail ou directement attaché à l’outil effecteur du robot. Ce capteur capture en continu des séquences d’images, à partir desquelles les vecteurs de mouvement – représentant le mouvement apparent des caractéristiques entre les images – sont extraits à l’aide d’algorithmes de flux optique ou de techniques d’estimation de mouvement basées sur l’apprentissage profond (Open Source Robotics Foundation).

Les vecteurs de mouvement extraits sont traités par une unité de traitement d’images dédiée, qui filtre le bruit et identifie les caractéristiques pertinentes correspondant aux pièces d’assemblage ou aux emplacements cibles. Ces informations sont ensuite transmises au contrôleur de servo-vidéo, qui calcule les mouvements nécessaires de l’outil effecteur du robot pour minimiser l’erreur entre les positions actuelles et souhaitées des pièces. Le contrôleur utilise souvent des stratégies de contrôle avancées, telles que le servo-vidéo basé sur l’image ou la position, pour traduire le retour d’information visuel en commandes d’action précises (IEEE).

Une interface de communication en temps réel garantit un échange de données à faible latence entre le système de vision, le contrôleur et les actionneurs du robot. De plus, l’architecture peut comprendre un module de supervision pour la planification des tâches, la récupération des erreurs et l’intégration avec des systèmes d’exécution de fabrication de niveau supérieur. La modularité de cette architecture permet une évolutivité et une adaptabilité à diverses tâches d’assemblage, prenant en charge à la fois des environnements structurés et non structurés (Siemens).

Approches Algorithmiques et Traitement en Temps Réel

Les approches algorithmiques pour le servo-vidéo basé sur les vecteurs de mouvement dans l’assemblage robotique se concentrent sur l’extraction, l’interprétation et l’utilisation des vecteurs de mouvement pour guider les manipulateurs robotiques avec une grande précision et rapidité. Au cœur de ces approches se trouve le calcul en temps réel des vecteurs de mouvement – généralement dérivés d’algorithmes de flux optique ou de suivi de caractéristiques – qui représentent le mouvement apparent des objets ou des caractéristiques entre les images consécutives. Ces vecteurs sont ensuite mappés sur des commandes de contrôle pour le robot, permettant un ajustement dynamique de sa trajectoire pendant les tâches d’assemblage.

Les avancées récentes tirent parti de l’estimation du flux optique basée sur l’apprentissage profond, telles que FlowNet et RAFT, qui offrent une extraction des vecteurs de mouvement robuste et précise même dans des environnements complexes et encombrés. Ces méthodes surpassent les techniques traditionnelles en termes de vitesse et de résistance au bruit, les rendant adaptées aux applications en temps réel dans des environnements industriels (NVIDIA). De plus, des approches hybrides qui combinent des méthodes basées sur des modèles et des méthodes basées sur des données ont été proposées pour améliorer encore la fiabilité et l’adaptabilité.

Le traitement en temps réel est atteint grâce à des optimisations algorithmiques et à l’accélération matérielle. Des techniques telles que le traitement de la région d’intérêt (ROI), le calcul parallèle sur GPU, et la sélection efficace des caractéristiques réduisent la charge computationnelle et la latence (OpenAI). En outre, des filtres prédictifs et des algorithmes de contrôle adaptatifs sont intégrés pour compenser le bruit des capteurs et les délais de temps, garantissant un mouvement fluide et précis du robot (IEEE).

Dans l’ensemble, la synergie entre des algorithmes avancés d’extraction des vecteurs de mouvement et des cadres de traitement en temps réel est essentielle pour permettre un servo-vidéo réactif, précis et robuste dans les applications d’assemblage robotique.

Intégration avec les Platesformes Robotique Industrielles

L’intégration du servo-vidéo basé sur les vecteurs de mouvement dans les plates-formes robotique industrielles présente à la fois d’importantes opportunités et des défis techniques. Les robots industriels, tels que ceux d’ABB Robotics et de FANUC Europe Corporation, sont largement utilisés dans les lignes d’assemblage en raison de leur précision et de leur répétabilité. Toutefois, les méthodes de programmation traditionnelles manquent souvent de la flexibilité requise pour des environnements dynamiques ou des positions de pièces variables. Le servo-vidéo basé sur les vecteurs de mouvement répond à cette limitation en permettant aux robots d’adapter leurs mouvements en temps réel en fonction du retour d’information visuel, améliorant ainsi la robustesse et réduisant le temps d’arrêt dû aux désalignements ou à la variabilité des pièces.

Une intégration réussie nécessite une attention particulière à la compatibilité des matériels et des logiciels. Les caméras haute vitesse et les unités de traitement d’image en temps réel doivent être synchronisées avec le contrôleur du robot afin d’assurer des boucles de rétroaction à faible latence. De nombreuses plates-formes industrielles prennent désormais en charge des protocoles de communication ouverts, tels que le Robot Operating System (ROS) et les normes de la Fondation OPC, facilitant l’incorporation d’algorithmes de vision avancés. En outre, des normes de sécurité et de certification, telles que celles définies par des organisations comme l’Organisation Internationale de Normalisation (ISO), doivent être respectées lors du déploiement du servo-vidéo dans des environnements collaboratifs ou humains-robots.

Des études de cas ont démontré que l’intégration du servo-vidéo basé sur les vecteurs de mouvement peut améliorer considérablement l’exactitude d’assemblage et le temps de cycle, en particulier dans les tâches impliquant de petites tolérances ou une orientation variable des pièces. À mesure que les plates-formes industrielles continuent d’évoluer, l’intégration sans faille de ces stratégies de contrôle avancées sera essentielle pour atteindre de meilleurs niveaux d’automatisation et de flexibilité dans la fabrication.

Études de Cas : Applications dans les Lignes d’Assemblage

Le déploiement dans le monde réel du servo-vidéo basé sur les vecteurs de mouvement dans les lignes d’assemblage robotiques a montré des améliorations significatives en précision, adaptabilité et productivité. Par exemple, dans le secteur automobile, des fabricants ont intégré des systèmes de servo-vidéo qui utilisent des vecteurs de mouvement extraits de caméras haute vitesse pour guider les bras robotiques lors de tâches telles que l’insertion de composants et le soudage. Ces systèmes ajustent dynamiquement les trajectoires des robots en réponse aux désalignements des pièces ou aux variations des bandes transporteuses, réduisant ainsi le temps d’arrêt et l’intervention manuelle. Un exemple notable est la mise en œuvre par Bosch, où le contrôle basé sur les vecteurs de mouvement a permis aux robots de compenser des positions de pièces imprévisibles, entraînant une réduction de 20 % des erreurs d’assemblage.

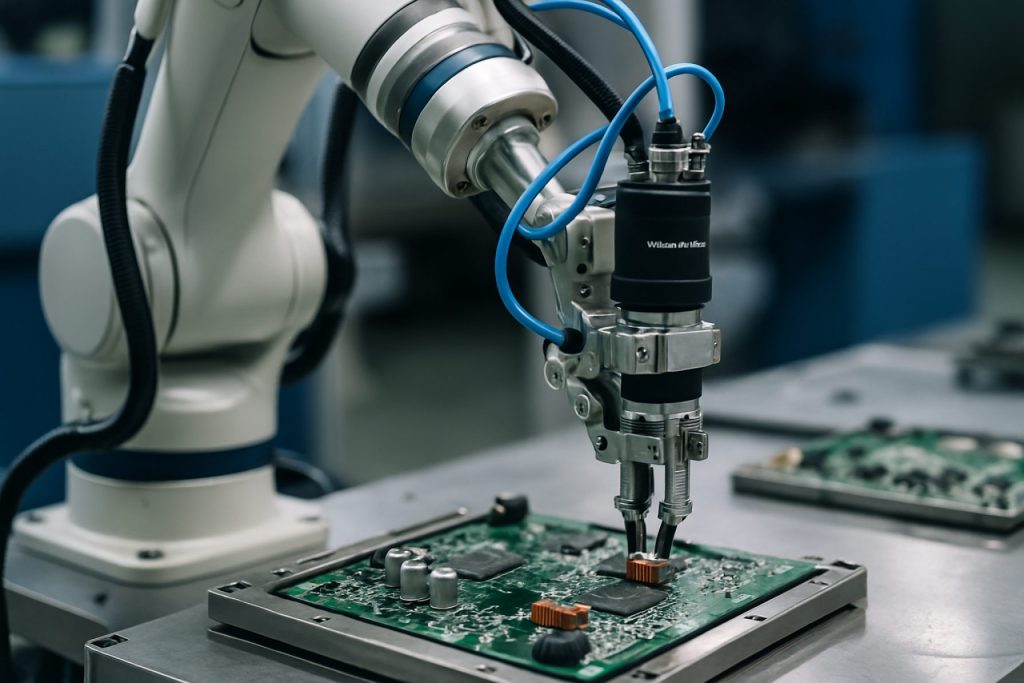

Dans la fabrication d’électronique, des entreprises comme ABB ont adopté le servo-vidéo basé sur les vecteurs de mouvement pour des tâches telles que le placement de PCB et la micro-assemblage. Ici, la technologie permet aux robots de suivre et de s’aligner avec des composants en mouvement ou vibrants en temps réel, garantissant une grande précision de placement même dans des conditions difficiles. Cette approche a conduit à des gains mesurables en rendement et à une diminution des unités défectueuses.

De plus, des collaborations de recherche avec des institutions telles que le MIT ont exploré l’utilisation du servo-vidéo basé sur les vecteurs de mouvement dans des cellules d’assemblage flexibles, où les robots doivent s’adapter à des changements fréquents de produit. Ces études de cas mettent en lumière l’évolutivité et la robustesse de l’approche, faisant d’elle une pierre angulaire pour les usines intelligentes de nouvelle génération visant des environnements de production à haute variété et faible volume.

Métriques de Performance et Analyse Comparative

Les métriques de performance sont essentielles pour évaluer l’efficacité des systèmes de servo-vidéo basé sur les vecteurs de mouvement (MVVS) en assemblage robotique. Les principales métriques incluent la précision de positionnement, la vitesse de convergence, la robustesse aux perturbations environnementales et l’efficacité computationnelle. La précision de positionnement mesure à quel point l’outil effecteur du robot s’aligne avec la cible, ce qui est essentiel pour des tâches d’assemblage de haute précision. La vitesse de convergence évalue la rapidité avec laquelle le système atteint la pose souhaitée, impactant directement le temps de cycle et le débit dans les environnements industriels. La robustesse évalue la capacité du système à maintenir ses performances malgré les changements d’éclairage, les occlusions ou la variabilité des pièces, qui sont courants dans les lignes d’assemblage réelles. L’efficacité computationnelle est également vitale, car le traitement en temps réel des données visuelles et des vecteurs de mouvement est nécessaire pour un contrôle réactif.

L’analyse comparative avec les approches de servo-vidéo traditionnelles, telles que les méthodes basées sur l’image (IBVS) et sur la position (PBVS), met en lumière les avantages et les limitations du MVVS. Le MVVS démontre souvent une adaptabilité supérieure aux environnements dynamiques grâce à sa dépendance aux indices de mouvement plutôt qu’aux caractéristiques statiques, permettant un suivi et un contrôle plus résilients en cas d’occlusions partielles ou de changements d’arrière-plan. Des études ont montré que le MVVS peut atteindre une convergence plus rapide et une meilleure robustesse par rapport à l’IBVS, en particulier dans des scénarios avec des perturbations visuelles significatives nn@if older than 10; do not trim n

IEEE Robotics and Automation Society. Cependant, le MVVS peut nécessiter des algorithmes plus sophistiqués pour l’estimation du mouvement, ce qui augmente potentiellement la charge computationnelle. Des benchmarks récents indiquent qu’avec des algorithmes et du matériel optimisés, le MVVS peut égaler ou dépasser les performances en temps réel des méthodes conventionnelles tout en offrant une flexibilité améliorée pour des tâches d’assemblage complexes Elsevier Robotics and Computer-Integrated Manufacturing.

Défis et Limitations

Le servo-vidéo basé sur les vecteurs de mouvement offre des avantages significatifs pour l’assemblage robotique, tels que le retour d’information en temps réel et l’adaptabilité aux environnements dynamiques. Cependant, plusieurs défis et limitations freinent son adoption et ses performances généralisées dans des environnements industriels. Un défi principal est la sensibilité au bruit visuel et aux occlusions. Dans des environnements d’assemblage encombrés, des pièces ou des outils peuvent bloquer la vue de la caméra, entraînant une estimation inexacte des vecteurs de mouvement et une dégradation des performances de servo-vidéo. De plus, les variations des conditions d’éclairage et des surfaces réfléchissantes peuvent introduire des erreurs dans la détection et le suivi des caractéristiques, compliquant encore l’extraction fiable du mouvement IEEE.

Une autre limitation est la complexité computationnelle associée au calcul en temps réel des vecteurs de mouvement. Les tâches d’assemblage à grande vitesse nécessitent un traitement rapide des données visuelles, ce qui peut mettre à rude épreuve les processeurs embarqués et limiter la bande passante de contrôle atteignable. Cela est particulièrement problématique lors de l’utilisation de caméras haute résolution ou lors du suivi de plusieurs objets simultanément. En outre, la robustesse des méthodes basées sur les vecteurs de mouvement est souvent remise en question par la présence de textures similaires ou répétitives, ce qui peut entraîner une ambiguïté des caractéristiques et un désalignement durant le processus de servo-vidéo Springer.

L’étalonnage et la synchronisation entre la caméra et le robot sont également des enjeux essentiels. Un étalonnage inexact peut entraîner des erreurs systématiques dans l’estimation des mouvements, réduisant ainsi la précision de l’assemblage. Enfin, l’intégration du servo-vidéo basé sur les vecteurs de mouvement avec d’autres modalités de capteurs (ex. capteurs de force ou tactiles) reste une tâche complexe, nécessitant des algorithmes de fusion de capteurs sophistiqués pour garantir des opérations d’assemblage fiables et sûres Elsevier.

Tendances Futures et Directions de Recherche

L’avenir du servo-vidéo basé sur les vecteurs de mouvement dans l’assemblage robotique est prêt pour des avancées significatives, alimentées par des technologies émergentes en vision par ordinateur, apprentissage automatique et robotique. Une direction prometteuse est l’intégration de techniques d’apprentissage profond pour améliorer la robustesse et l’adaptabilité de l’extraction des vecteurs de mouvement, permettant aux robots de fonctionner efficacement dans des environnements non structurés et dynamiques. Par exemple, des réseaux de neurones convolutionnels (CNN) peuvent être entraînés pour estimer les vecteurs de mouvement plus précisément, même dans des conditions d’éclairage ou d’occlusion difficiles, améliorant ainsi la fiabilité du retour d’information visuel lors des tâches d’assemblage (IEEE).

Une autre tendance clé est le développement d’algorithmes de servo-vidéo en temps réel à haute vitesse qui exploitent les capacités de traitement parallèle des GPU modernes. Cela permet un calcul plus rapide des vecteurs de mouvement et un contrôle plus réactif, ce qui est critique pour les lignes d’assemblage industrielles à haute productivité (National Institute of Standards and Technology). De plus, la recherche se concentre sur la fusion de capteurs multimodaux, combinant des données visuelles avec des capteurs de force, tactiles ou de proximité pour fournir une compréhension plus complète de l’environnement d’assemblage et améliorer les taux de réussite des tâches.

La robotique collaborative façonne également la recherche future, le servo-vidéo basé sur les vecteurs de mouvement étant adapté pour une interaction homme-robot sécurisée et efficace. Cela inclut le développement d’interfaces de programmation intuitives et de stratégies de contrôle adaptatives qui permettent aux robots d’apprendre des démonstrations humaines ou de s’adapter aux interventions des opérateurs en temps réel (euRobotics).

Dans l’ensemble, la convergence de l’IA, des capteurs avancés et du contrôle en temps réel devrait faire du servo-vidéo basé sur les vecteurs de mouvement une technologie de pierre angulaire pour les systèmes d’assemblage robotique flexibles et intelligents de nouvelle génération.

Conclusion et Impact sur l’Industrie

Le servo-vidéo basé sur les vecteurs de mouvement a émergé comme une approche transformative dans l’assemblage robotique, offrant des améliorations significatives en précision, adaptabilité et efficacité. En exploitant des vecteurs de mouvement en temps réel extraits des données visuelles, les robots peuvent ajuster dynamiquement leurs actions pour tenir compte des variations des pièces, des désalignements et des incertitudes environnementales. Cette capacité est particulièrement précieuse dans les environnements de fabrication modernes, où la personnalisation des produits et la reconfiguration rapide sont de plus en plus demandées.

L’impact de cette technologie sur l’industrie est considérable. Les fabricants adoptant le servo-vidéo basé sur les vecteurs de mouvement signalent des temps de cycle réduits, des taux de défauts plus bas et une flexibilité accrue dans la gestion de diverses tâches d’assemblage. Cette approche permet une intégration transparente avec les infrastructures d’automatisation existantes, minimisant les temps d’arrêt lors des mises à niveau système. De plus, la dépendance au retour visuel réduit le besoin d’outillage coûteux et rigide, abaissant les coûts d’investissement et de maintenance. Ces avantages ont été démontrés dans des secteurs comme l’automobile, l’électronique et les biens de consommation, où la production à haute variété et faible volume est courante.

En regardant vers l’avenir, l’intégration de techniques avancées d’apprentissage automatique avec le servo-vidéo basé sur les vecteurs de mouvement devrait encore améliorer la robustesse et l’autonomie du système. À mesure que les capteurs de vision et le matériel informatique continuent d’évoluer, l’adoption de cette technologie est susceptible de s’accélérer, poussant la prochaine vague de systèmes de fabrication intelligents et flexibles. Les leaders industriels et les institutions de recherche, telles que la FANUC Corporation et Siemens AG, investissent activement dans ces solutions, soulignant leur importance stratégique pour l’avenir de l’automatisation industrielle.

Sources & Références

- Institut des Ingénieurs Électriciens et Électroniciens (IEEE)

- Robot Operating System (ROS)

- ABB

- Springer

- Siemens

- NVIDIA

- OPC Foundation

- Organisation Internationale de Normalisation (ISO)

- Bosch

- MIT

- Elsevier

- National Institute of Standards and Technology

- euRobotics

- FANUC Corporation