Präzision und Anpassungsfähigkeit freischalten: Wie die Sensorfusion in geschlossenen Regelkreisen die robotergestützte Montage revolutioniert. Entdecken Sie die nächste Generation intelligenter Automatisierungssysteme.

- Einführung in die Sensorfusion in geschlossenen Regelkreisen in der Robotik

- Kernprinzipien und Technologien der Sensorfusion

- Vorteile von geschlossenen Regelkreissystemen in der robotergestützten Montage

- Wichtige Sensortypen und Datenintegrationsstrategien

- Echtzeit-Feedback und adaptive Steuerungsmechanismen

- Fallstudien: Erfolgsgeschichten in der industriellen Montage

- Herausforderungen und Einschränkungen der aktuellen Ansätze

- Zukünftige Trends und Innovationen in der Sensorfusion für die Robotik

- Fazit: Der Weg voraus für intelligente robotergestützte Montage

- Quellen & Referenzen

Einführung in die Sensorfusion in geschlossenen Regelkreisen in der Robotik

Die Sensorfusion in geschlossenen Regelkreisen ist eine entscheidende Technologie zur Verbesserung der Präzision und Anpassungsfähigkeit robotergestützter Montagesysteme. In diesem Kontext bezieht sich Sensorfusion auf die Integration von Daten aus mehreren heterogenen Sensoren – wie Kraft-Drehmoment-Sensoren, Visionssystemen und taktilen Arrays – um eine umfassende und robuste Wahrnehmung der Montageumgebung zu schaffen. Der Aspekt „geschlossener Regelkreis“ bezeichnet den kontinuierlichen Feedback-Mechanismus, bei dem Echtzeit-Sensordaten verwendet werden, um die Aktionen des Roboters dynamisch anzupassen und ein reaktives und adaptives Verhalten während der Montagetätigkeiten zu ermöglichen.

Die robotergestützte Montage findet oft in komplexen, unstrukturierten Umgebungen statt, in denen Unsicherheiten wie Teilefehlanpassung, variable Toleranzen und unerwartete Hindernisse auftreten können. Traditionelle Regelungsstrategien in offenen Regelkreisen, die sich auf vorprogrammierte Bewegungen und eingeschränkte Sensorik stützen, sind unzureichend, um mit solch variablen Gegebenheiten umzugehen. Die Sensorfusion in geschlossenen Regelkreisen begegnet diesen Herausforderungen, indem sie die Stärken verschiedener Sensormodalitäten nutzt: Visionssysteme bieten globale räumliche Wahrnehmung, Kraft-Drehmoment-Sensoren erkennen Kontakt und Nachgiebigkeit, und taktile Sensoren liefern präzise Interaktionsdaten zur Oberfläche. Durch die Fusion dieser Datenströme können Roboter eine höhere Genauigkeit bei der Teilelokalisierung, beim Einfügen und bei kraftgesteuerten Manövern erreichen, selbst in Anwesenheit von Störungen oder Unsicherheiten.

Jüngste Fortschritte im maschinellen Lernen und in der Echtzeit-Datenverarbeitung haben die Fähigkeiten der Sensorfusion in geschlossenen Regelkreisen weiter verbessert, was zu anspruchsvolleren Entscheidungsfindungs- und adaptiven Steuerungsstrategien führt. Dies hat zu erheblichen Verbesserungen der Montagequalität, der Zykluszeit und der Fähigkeit geführt, eine breitere Vielfalt an Teilen und Aufgaben zu handhaben. Dementsprechend wird die Sensorfusion in geschlossenen Regelkreisen zunehmend als eine Grundlagentechnologie für die nächste Generation flexibler und intelligenter robotergestützter Montagesysteme anerkannt National Institute of Standards and Technology, IEEE.

Kernprinzipien und Technologien der Sensorfusion

Die Sensorfusion in geschlossenen Regelkreisen in der robotergestützten Montage nutzt die Integration mehrerer Sensormodalitäten – wie Vision, Kraft/Drehmoment, taktile und Näherungssensoren – um robuste, adaptive und präzise Manipulation in dynamischen Umgebungen zu erreichen. Das Kernprinzip besteht darin, komplementäre Informationen von heterogenen Sensoren zu kombinieren und so die Einschränkungen einzelner Sensoren auszugleichen und das Situationsbewusstsein sowie die Steuerungsgenauigkeit des Roboters zu verbessern. Diese Fusion wird typischerweise durch probabilistische Rahmenwerke (z. B. Kalman-Filter, Partikelfilter) oder deep learning-basierte Ansätze implementiert, die es dem System ermöglichen, den Zustand der Umgebung und des Roboters mit höherem Vertrauen und Robuste gegenüber Rauschen oder Abschattung zu schätzen.

Eine Architektur mit geschlossenem Regelkreis stellt sicher, dass Sensordaten kontinuierlich in das Steuersystem zurückgespeist werden, wodurch Echtzeitanpassungen an den Aktionen des Roboters ermöglicht werden. Zum Beispiel kann visuelles Feedback die grobe Positionierung leiten, während Kraft/Drehmoment-Sensoren präzise Ausrichtungs- und Einfügearbeiten ermöglichen, die für die hochpräzise Montage entscheidend sind. Taktile Sensoren verbessern außerdem die Fähigkeit des Roboters, Kontaktevents zu erkennen und Griffkräfte anzupassen, wodurch das Risiko von Teilebeschädigungen oder Fehlanpassungen reduziert wird. Die Synchronisation und zeitliche Ausrichtung mehrerer Sensordatenströme sind kritische Herausforderungen, die häufig durch Zeitstempelung, Sensor-Kalibrierung und Datenassoziationsalgorithmen adressiert werden.

Jüngste Fortschritte im Edge Computing und in Hochgeschwindigkeitskommunikationsprotokollen haben die Echtzeitverarbeitung erleichtert, die für die Sensorfusion in geschlossenen Regelkreisen erforderlich ist, und ermöglichen komplexere und reaktionsschnellere Montagestrategien. Diese Technologien werden aktiv von Organisationen wie der International Organization for Standardization und dem Institute of Electrical and Electronics Engineers entwickelt und standardisiert, um Interoperabilität und Sicherheit in industriellen Robotersystemen zu gewährleisten.

Vorteile von geschlossenen Regelkreissystemen in der robotergestützten Montage

Die Systeme zur Sensorfusion in geschlossenen Regelkreisen bieten erhebliche Vorteile in der robotergestützten Montage, hauptsächlich durch die Ermöglichung von Echtzeit-Feedback und adaptiver Kontrolle. Im Gegensatz zu offenen Regelkreisen, die sich ausschließlich auf vorprogrammierte Anweisungen verlassen, integrieren geschlossene Regelkreisarchitekturen kontinuierlich Daten von mehreren Sensoren – wie Kraft-Drehmoment-, Visions- und taktilen Sensoren – um die Aktionen des Roboters während der Montage zu überwachen und anzupassen. Dieser dynamische Feedbackschleifen-Mechanismus verbessert die Präzision und ermöglicht es Robotern, Unsicherheiten in der Teilepositionierung, den Toleranzen und den Umweltvariationen, die in industriellen Umgebungen häufig vorkommen, auszugleichen.

Ein entscheidender Vorteil ist die verbesserte Montagenauigkeit. Durch die Fusion von Daten aus verschiedenen Sensoren kann das System Fehlanpassungen oder unerwartete Hindernisse erkennen und sofort korrigieren, wodurch das Risiko von Defekten und Nacharbeit verringert wird. Diese Anpassungsfähigkeit ist insbesondere in der hochgemischten, geringvolumigen Fertigung von Wert, wo Teilevariabilität häufig vorkommt. Darüber hinaus erhöht die Sensorfusion in geschlossenen Regelkreisen die Robustheit des Prozesses, da der Roboter Fehler autonom erkennen und beheben kann, wodurch Ausfallzeiten und menschliches Eingreifen minimiert werden.

Ein weiterer Vorteil ist die verbesserte Sicherheit. Die Echtzeitüberwachung ermöglicht es dem System, anormale Kräfte oder Kollisionen zu erkennen und rechtzeitig zu reagieren, um Schäden an Geräten oder Verletzungen zu verhindern. Darüber hinaus erleichtern geschlossene Regelkreissysteme eine effizientere Nutzung von Ressourcen, indem sie Montagebahnen optimieren und die Zykluszeiten reduzieren, was zu Gesamtproduktivitätsgewinnen beiträgt. Diese Vorteile werden zunehmend in fortschrittlichen Fertigungssektoren anerkannt, wie von Organisationen wie dem National Institute of Standards and Technology und der International Organization for Standardization betont, die die Rolle der Sensorfusion und des Feedbacks bei der Erreichung zuverlässiger, flexibler und sicherer robotergestützter Montageprozesse hervorheben.

Wichtige Sensortypen und Datenintegrationsstrategien

Die Sensorfusion in geschlossenen Regelkreisen in der robotergestützten Montage nutzt mehrere Sensormodalitäten, um hochpräzise, adaptive und robuste Automatisierung zu erreichen. Die häufigsten Sensortypen sind Kraft/Drehmoment-Sensoren, Visionssysteme (2D/3D-Kameras), taktile Sensoren und Näherungssensoren. Jeder Sensor liefert einzigartige Daten: Kraft/Drehmoment-Sensoren ermöglichen Echtzeit-Feedback zu Kontaktkräften während Einfüg- oder Ausrichtungstätigkeiten; Visionssysteme bieten räumliche und Objekterkennungskapazitäten; taktile Sensoren erkennen feine Oberflächenmerkmale und Rutschbewegungen; und Näherungssensoren unterstützen bei der Kollisionserkennung und Teilelokalisierung.

Die Integration dieser heterogenen Datenströme erfordert anspruchsvolle Datenfusionsstrategien. Die niederstufige (Sensor-)Fusion verbindet Rohdaten, wie die Verschmelzung von Kraft- und taktilen Signalen zur Verbesserung der Kontakterkennung. Die mid-level (Merkmals-)Fusion extrahiert und kombiniert Merkmale – wie die Objektpose aus der Vision und Kontaktpunkte von Kraftsensoren – um Steuerungsentscheidungen zu informieren. Die hochstufige (Entscheidungs-)Fusion synthetisiert unabhängige Sensorinterpretationen, wobei probabilistische Rahmenwerke oder maschinelles Lernen genutzt werden, um Mehrdeutigkeiten zu lösen und die Zuverlässigkeit zu verbessern.

Ein häufiger Ansatz ist die Verwendung von Kalman-Filtern oder Partikelfiltern für die Echtzeitschätzung des Zustands, bei der rauschbehaftete Sensordaten kombiniert werden, um genaue, robuste Schätzungen der Teileposition und -orientierung zu erzeugen. In jüngster Zeit wurden tiefenlernende Fusionsarchitekturen untersucht, die es dem System ermöglichen, optimale Integrationsstrategien aus Daten zu lernen, insbesondere in unstrukturierten oder variablen Umgebungen. Die Wahl der Integrationsstrategie hängt von der Komplexität der Montageaufgabe, der erforderlichen Präzision und den rechentechnischen Einschränkungen ab.

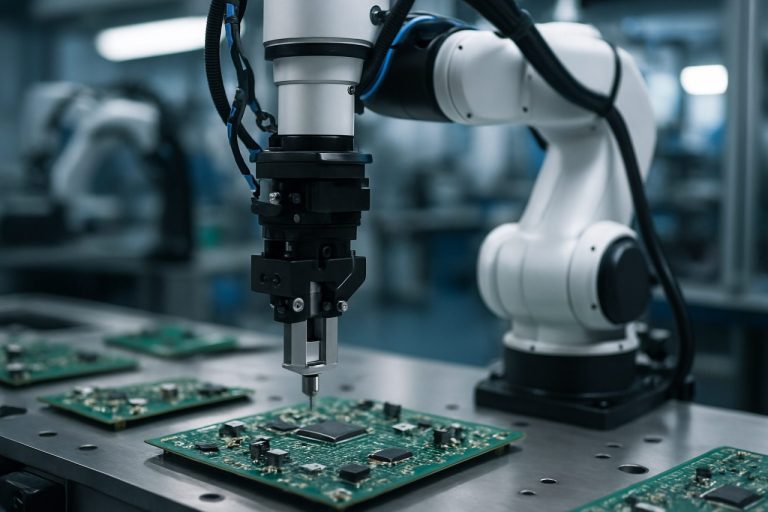

Eine effektive Sensorfusion in geschlossenen Regelkreisen verbessert die Anpassungsfähigkeit an Teile-Toleranzen, gleicht Unsicherheiten aus und ermöglicht es Robotern, komplexe Montageoperationen mit minimalem menschlichem Eingreifen durchzuführen, wie von Organisationen wie FANUC America und KUKA Robotics in fortschrittlichen Fertigungseinstellungen demonstriert.

Echtzeit-Feedback und adaptive Steuerungsmechanismen

Echtzeit-Feedback und adaptive Steuerungsmechanismen sind kritische Komponenten in der Sensorfusion in geschlossenen Regelkreisen für die robotergestützte Montage, die es Robotern ermöglichen, ihre Aktionen dynamisch auf Basis kontinuierlicher sensorischer Eingaben anzupassen. Bei komplexen Montageaufgaben müssen Roboter mit Unsicherheiten wie Teilefehlanpassungen, variablen Toleranzen und unerwarteten Umweltveränderungen zurechtkommen. Durch die Integration von Daten aus mehreren Sensoren – wie Kraft-Drehmoment-Sensoren, Visionssystemen und taktilen Arrays – bieten geschlossene Regelkreisarchitekturen ein umfassendes Situationsbewusstsein, das präzise Manipulation und Fehlerkorrektur unterstützt.

Adaptive Steuerungsalgorithmen nutzen diese fusionierten sensorischen Informationen, um Steuerungsparameter in Echtzeit anzupassen und so auch in Gegenwart von Störungen oder Modellschwankungen eine robuste Leistung sicherzustellen. Wenn beispielsweise ein Visionssystem während einer Peg-in-Hole-Aufgabe eine leichte Fehlanpassung erkennt, kann der Roboter das Feedback der Kraftsensoren verwenden, um seine Trajektorie in Echtzeit anzupassen und das Risiko von Blockierungen oder Teilebeschädigungen zu minimieren. Diese Synergie zwischen Wahrnehmung und Kontrolle ist entscheidend, um hohe Zuverlässigkeit und Flexibilität in automatisierten Montageanlagen zu erreichen.

Jüngste Fortschritte im maschinellen Lernen haben die adaptive Kontrolle weiter verbessert, indem sie prädiktive Modellierung und Anomalieerkennung ermöglichen, sodass Roboter potenzielle Fehler antizipieren und ausgleichen können, bevor sie auftreten. Diese Entwicklungen werden in industriellen Umgebungen aktiv erforscht, wie durch Initiativen von Organisationen wie dem National Institute of Standards and Technology und Forschungsprojekten am Massachusetts Institute of Technology hervorgehoben. Die fortlaufende Integration von Echtzeit-Feedback und adaptiven Steuerungsmechanismen ist somit ein Eckpfeiler der Robotersysteme der nächsten Generation in der Montagetechnologie, die Verbesserungen bei Effizienz, Sicherheit und Autonomie vorantreibt.

Fallstudien: Erfolgsgeschichten in der industriellen Montage

Die Sensorfusion in geschlossenen Regelkreisen hat erheblichen Erfolg bei der Verbesserung der Präzision, Zuverlässigkeit und Anpassungsfähigkeit robotergestützter Montagesysteme in verschiedenen Industriebranchen gezeigt. Ein bemerkenswerter Fall ist der Einsatz von Sensorfusion in der Automobilproduktion, bei dem Unternehmen wie die BMW Group Visions-, Kraft- und Drehmomentsensoren integriert haben, damit Roboter komplexe Aufgaben wie Motorenmontage und Komponentenpassung ausführen können. Durch die kontinuierliche Fusion von Daten aus mehreren Sensoren passen diese Systeme ihre Aktionen in Echtzeit dynamisch an und gleichen Teile-Toleranzen und unerwartete Variationen in der Montagelinie aus.

Eine weitere Erfolgsgeschichte stammt aus der Elektronikindustrie, in der ABB die Sensorfusion in geschlossenen Regelkreisen bei der Montage empfindlicher elektronischer Komponenten implementiert hat. Hier ermöglicht die Fusion von taktilem und visuellem Feedback Robotern, fragile Teile mit hoher Genauigkeit zu handhaben, was die Defektrate verringert und den Durchsatz verbessert. Die Fähigkeit des Systems, Fehlanpassungen in Echtzeit zu erkennen und zu korrigieren, hat zu messbaren Verbesserungen in der Ausbeute und Produktqualität geführt.

In der Luft- und Raumfahrt hat Airbus die Sensorfusion in geschlossenen Regelkreisen für Aufgaben wie Bohren und Befestigen übernommen, wo Präzision entscheidend ist. Durch die Integration von Laserscannern, Kraftsensoren und Maschinenvision erreichen ihre robotergestützten Systeme Mikrometergenauigkeit und gewährleisten so die strukturelle Integrität und die Einhaltung strenger Sicherheitsstandards. Diese Fallstudien verdeutlichen insgesamt, wie die Sensorfusion in geschlossenen Regelkreisen die industrielle Montage transformiert und es Robotern ermöglicht, mit größerer Autonomie und Widerstandsfähigkeit in dynamischen, unstrukturierten Umgebungen zu arbeiten.

Herausforderungen und Einschränkungen der aktuellen Ansätze

Trotz erheblicher Fortschritte sieht sich die Sensorfusion in geschlossenen Regelkreisen für die robotergestützte Montage mehreren anhaltenden Herausforderungen und Einschränkungen gegenüber. Ein zentrales Problem ist die Integration heterogener Sensordaten, wie visueller, Kraft-Drehmoment- und taktiler Eingaben, die oft unterschiedliche Abtastraten, Rauschmerkmale und räumliche Auflösungen aufweisen. Eine robuste Echtzeitfusion unter diesen Bedingungen bleibt schwierig, insbesondere in dynamischen oder unstrukturierten Umgebungen, in denen Sensorverdeckungen und Signalverschlechterung häufig sind. Außerdem führen Kalibrierung und Synchronisation mehrerer Sensoren zu weiteren Komplikationen, da selbst geringfügige Fehlanpassungen erhebliche Fehler bei der Zustandsschätzung und Kontrolle verursachen können.

Eine weitere Einschränkung ist die rechnerische Belastung, die mit fortgeschrittenen Fusionsalgorithmen, wie tiefenlernbasierten oder probabilistischen Methoden, verbunden ist. Diese Ansätze erfordern häufig erhebliche Rechenleistung und Speicher, was möglicherweise nicht für eingebettete Robotplattformen mit strengen Echtzeitanforderungen realisierbar ist. Zudem bremst das Fehlen standardisierter Benchmarks und Datensätze für die Sensorfusion in Montageaufgaben die objektive Bewertung und den Vergleich verschiedener Methoden und verlangsamt den Fortschritt im Bereich.

Geschlossene Regelkreissysteme stehen auch vor Herausforderungen bei der Anpassungsfähigkeit und der Verallgemeinerungsfähigkeit. Viele aktuelle Lösungen sind auf spezifische Montageaufgaben oder Umgebungen zugeschnitten, was ihre Übertragbarkeit auf neue Szenarien oder Produkte einschränkt. Darüber hinaus kann die Abhängigkeit von genauen Modellen sowohl des Roboters als auch der Umgebung problematisch sein, wenn es um Unsicherheiten oder unvorhergesehene Änderungen während der Montage geht. Die Bewältigung dieser Herausforderungen erfordert Fortschritte in der Sensortechnologie, algorithmischer Effizienz und die Entwicklung flexiblerer, adaptiver Fusionsrahmenwerke, wie von Organisationen wie dem National Institute of Standards and Technology und dem Institute of Electrical and Electronics Engineers hervorgehoben.

Zukünftige Trends und Innovationen in der Sensorfusion für die Robotik

Die Zukunft der Sensorfusion in geschlossenen Regelkreisen in der robotergestützten Montage steht vor bedeutenden Fortschritten, die durch die Integration von künstlicher Intelligenz, Edge Computing und neuartigen Sensortechnologien vorangetrieben werden. Ein aufkommender Trend ist die Einführung von tiefen Lernalgorithmen zur Echtzeitinterpretation von Sensordaten, die es Robotern ermöglicht, sich dynamisch an komplexe und unvorhersehbare Montageumgebungen anzupassen. Diese KI-gesteuerten Ansätze ermöglichen eine robustere Fusion heterogener Sensordaten – wie visuelle, Kraft-Drehmoment- und taktile Eingaben – um das Situationsbewusstsein und die Entscheidungsfähigkeiten des Roboters zu verbessern. Zum Beispiel ermöglicht die Verwendung von Convolutional Neural Networks (CNNs) zur visuell-taktilen Fusion präzisere Manipulation und Fehlerkorrektur während Montageaufgaben (IEEE).

Eine weitere Innovation ist der Einsatz von Edge-Computing-Architekturen, die Sensordaten lokal auf dem Roboter verarbeiten, wodurch die Latenz verringert und die Reaktionsfähigkeit von Regelungssystemen in geschlossenen Regelkreisen verbessert wird. Dies ist besonders wichtig für Hochgeschwindigkeits- oder sicherheitskritische Montagevorgänge, bei denen sofortiges Feedback von entscheidender Bedeutung ist (National Institute of Standards and Technology). Darüber hinaus erweitert die Integration von weichen und flexiblen Sensoren die Bandbreite der erkennbaren physischen Interaktionen und ermöglicht es Robotern, delikate oder unregelmäßige Komponenten mit größerer Geschicklichkeit zu handhaben.

Für die Zukunft wird erwartet, dass die Konvergenz von 5G-Konnektivität und cloudbasierten Analysen die Möglichkeiten der Sensorfusion weiter verbessern wird, indem sie verteiltes Lernen und collaborative Montage zwischen mehreren Robotern ermöglicht. Standardisierungsbemühungen und Open-Source-Frameworks beschleunigen ebenfalls die Einführung fortschrittlicher Techniken zur Sensorfusion in der Robotik (International Organization for Standardization). Gemeinsam werden diese Trends voraussichtlich die Sensorfusion in geschlossenen Regelkreisen zu einem Eckpfeiler der Systeme für robotergestützte Montage der nächsten Generation machen und Verbesserungen bei Effizienz, Anpassungsfähigkeit und Zuverlässigkeit vorantreiben.

Fazit: Der Weg voraus für intelligente robotergestützte Montage

Die Integration der Sensorfusion in geschlossenen Regelkreisen in der robotergestützten Montage stellt einen entscheidenden Fortschritt in Richtung intelligenterer, anpassungsfähigerer und zuverlässigerer Fertigungssysteme dar. Indem sie Echtzeitdaten von heterogenen Sensoren – wie Vision, Kraft-Drehmoment- und taktilen Arrays – nutzen, können Roboter ihre Aktionen dynamisch anpassen und Unsicherheiten sowie Variationen, die bei komplexen Montageaufgaben auftreten, ausgleichen. Diese Fähigkeit verbessert nicht nur die Präzision und Robustheit, sondern ermöglicht auch eine größere Flexibilität beim Umgang mit unterschiedlichen Komponenten und Umgebungen.

Aus der Sicht der Zukunft wird der Weg für intelligente robotergestützte Montage durch mehrere vielversprechende Richtungen geprägt. Erstens wird die Entwicklung ausgefeilterer Sensorfusion-Algorithmen, insbesondere solcher, die tiefes Lernen und probabilistische Überlegungen nutzen, das Situationsbewusstsein und die Entscheidungsfähigkeiten des Roboters weiter verbessern. Zweitens werden Fortschritte im Edge Computing und in Hochgeschwindigkeitskommunikationsprotokollen wahrscheinlich die Latenz reduzieren und damit noch engere Feedbackschleifen und reaktionsschnellere Steuerungssysteme ermöglichen. Drittens wird die Integration von digitalen Zwillingen und Simulationsumgebungen die schnelle Prototypenerstellung und Validierung von Strategien zur Sensorfusion vor der Implementierung auf physischen Systemen erleichtern.

Dennoch bleiben Herausforderungen bestehen, darunter die Notwendigkeit von standardisierten Schnittstellen, skalierbaren Architekturen und robusten Cybersicherheitsmaßnahmen zum Schutz sensibler Fertigungsdaten. Kollaborative Anstrengungen zwischen Wissenschaft, Industrie und Normungsorganisationen werden entscheidend sein, um diese Probleme anzugehen und die Einführung von Sensorfusion in geschlossenen Regelkreisen in realen Anwendungen zu beschleunigen. Wenn diese Technologien reifen, rückt die Vision von vollständig autonomen, selbstoptimierenden robotergestützten Montagelinien – die in Echtzeit lernen und sich anpassen können – immer näher an die Realität, was erhebliche Gewinne in Bezug auf Produktivität, Qualität und Betriebssicherheit verspricht National Institute of Standards and Technology International Organization for Standardization.

Quellen & Referenzen

- National Institute of Standards and Technology

- IEEE

- International Organization for Standardization

- FANUC America

- KUKA Robotics

- Massachusetts Institute of Technology

- Airbus